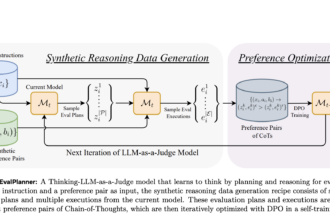

„Meta AI“ siūlo „Evalplanner“: „Mind-llm-as-a-a-teismo“ pasirinkimo optimizavimo algoritmas

Spartus didelių kalbos modelių tobulinimas (LLMS) žymiai pagerino jų sugebėjimą generuoti ilgos…

Agentic AI: The Foundations Based on Perception Layer, Knowledge Representation and Memory Systems

Agentic AI stands at the intersection of autonomy, intelligence, and adaptability, offering…

Atviros mintys: atvirojo kodo iniciatyva, skatinanti AI samprotavimus su aukštos kokybės duomenų rinkiniais ir tokiais modeliais kaip „Openthoughts-114K“ ir „Openthinker-7B“

Kritinis ribotos prieigos prie aukštos kokybės samprotavimo duomenų rinkinių klausimas turi ribotą…

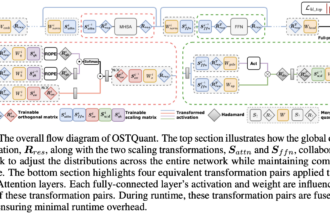

Kiekybinio erdvės panaudojimo greitis (QSUR): naujas kvantizavimo metodas, skirtas padidinti didelių kalbos modelių efektyvumą (LLM) (LLM)

Po mokymo kvantizavimas (PTQ) Dėmesys yra skirtas sumažinti dydį ir pagerinti didelių…

„NVIDIA AI“ išleidžia „Eagle2“ serijos vizijos kalbos modelį: SOTA rezultatų pasiekimas įvairiuose multimodaliniuose etalonuose

„Vision-Language“ modeliai (VLMS) žymiai išplėtė AI sugebėjimą apdoroti multimodalinę informaciją, tačiau jie…

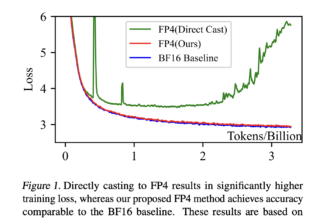

Optimizavimas naudojant FP4 kiekybinį itin mažą tikslumo kalbos modelio mokymą

Didelių kalbos modeliai (LLM) tapo transformacinėmis tyrimų ir pramonės priemonėmis, o jų…

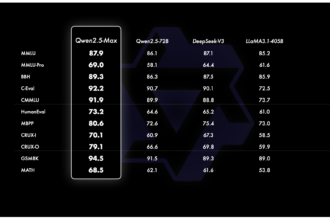

„Qwen AI“ pristato „Qwen2.5-MAX“: didelis „Moe LLM“, iš anksto iš anksto pateiktas pagal masyvius duomenis, ir po mokymo su kuruojamais SFT ir RLHF receptais

Dirbtinio intelekto sritis greitai vystosi, didėjant pastangoms sukurti pajėgesnius ir efektyvesnius kalbos…

Išsamus koncepcijų, skirtų tobulinti didelių kalbų modelius, koncepcijų vadovas (LLMS)

Dabartiniam pokalbiui apie plačiai paplitusius LLMS AI labai svarbu suprasti kai kuriuos…

Elon Musk’s IQ and the Nature of Genius • AI Blog

Podcast TranscriptBob - 0:00Right Then today we're taking a deep dive into…

AI technologijos • AI tinklaraštis

Dirbtinio intelekto tinklaraštis AI tinklaraštis yra pirmaujantis balsas dirbtinio intelekto pasaulyje, skirtas…